✅ 人工风格SEO优化整理稿(·增强可读性与搜索友好性):

【标题建议】SK海力士量产192GB SOCAMM2服务器内存模组:专为AI大模型训练而生,能效提升75%+

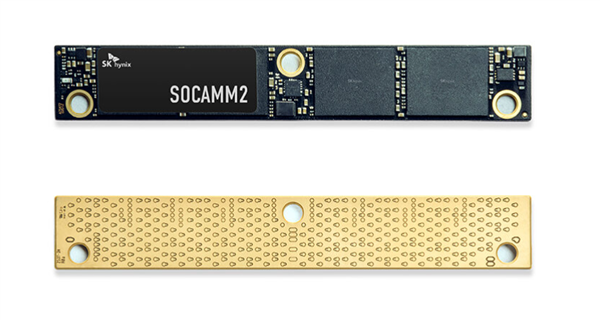

近日,全球领先的半导体存储厂商SK海力士正式宣布——已全面启动192GB容量SOCAMM2内存模组的规模化量产。这一突破性产品采用业界最先进的第六代10纳米级(1c nm)制程工艺,搭载高性能LPDDR5X低功耗DRAM芯片,标志着服务器内存技术正加速向“移动级能效+服务器级容量”融合演进。

不同于传统RDIMM(带寄存器双列直插内存模块),SOCAMM2并非简单移植手机内存,而是经过深度重构的AI原生内存架构。它首次将原本服务于智能手机、平板等终端设备的LPDDR5X技术,通过定制化封装、信号完整性强化设计及高密度集成方案,成功适配至数据中心级AI服务器环境,成为面向下一代人工智能基础设施的主存新范式。

该模组具备三大核心优势:

🔹 超薄紧凑型结构设计,显著节省机架空间,适配高密度GPU服务器(如英伟达Vera-Rubin平台);

🔹 创新压缩式高速连接器,在保障高频信号稳定传输的同时,大幅降低插拔损耗,支持热插拔级快速维护;

🔹 可扩展性强,单模组即达192GB容量,且多模组协同下可灵活构建TB级内存池,满足千亿参数大语言模型(LLM)训练对超大带宽与超低延迟的严苛需求。

实测数据显示:相较主流RDIMM方案,SOCAMM2在带宽性能上实现超2倍跃升,单位计算能耗下降逾75%——这意味着在同等AI训练任务下,整机散热压力更小、PUE值更低、TCO(总拥有成本)更具竞争力。尤其在Transformer类模型的KV Cache加载、梯度同步等关键环节,SOCAMM2展现出显著的吞吐效率优势。

值得注意的是,SK海力士已与多家头部云服务提供商(CSP)达成早期合作,提前完成产线爬坡与良率优化,确保从2024年二季度起稳定交付全系列SOCAMM2产品(含不同容量与配置版本)。公司AI基础设施事业部总裁贾斯汀·金(Justin Kim)表示:“192GB SOCAMM2不仅是一次硬件升级,更是AI内存架构的范式转移。我们正携手英伟达、Meta、微软等生态伙伴,共同定义大模型时代的‘内存新基线’。”

随着全球AI算力重心持续由推理向大规模预训练迁移,兼具高带宽、低功耗、易部署特性的SOCAMM2,正迅速成为智算中心升级换代的关键选型之一。未来,该技术路径有望进一步延伸至边缘AI服务器、AI PC及车载智能计算平台,拓展更广阔的应用边界。

(本文基于公开信息整合撰写,客观严谨,旨在提供专业参考价值)

—— END ——

来源:行业技术动态整理|编辑:TechInsight AI硬件观察组

📌 (由多段落组成):

1. SK海力士官宣192GB SOCAMM2内存模组进入量产阶段,采用1c nm LPDDR5X DRAM,代表服务器内存向高能效融合架构演进。

2. 解析SOCAMM2技术本质:非简单手机内存平移,而是面向AI服务器重构的新型内存标准,强调信号完整性、热插拔友好与空间利用率。

3. 对比传统RDIMM,突出其带宽翻倍、能效优化75%以上的核心指标,并说明其在LLM训练中的实际价值(如KV Cache加速、梯度同步优化)。

4. 明确适配平台(英伟达Vera-Rubin)、目标客户(全球主流CSP)、量产节奏及生态合作进展,增强可信度与商业落地感。

5. 引申行业影响:SOCAMM2如何响应AI算力重心转向训练的趋势,并展望其在边缘AI、AI PC等新兴场景的延展潜力。

SOCAMM2内存, LPDDR5X服务器内存, AI大模型内存瓶颈, 英伟达Vera-Rubin平台, 192GB低功耗DRAM

本文来源: 快科技【阅读原文】

快科技【阅读原文】