(由多段落组成):

2025年10月9日,中国AI领域再掀波澜——蚂蚁集团正式开源其百灵大模型系列的首款旗舰级语言模型 Ling-1T,一个拥有万亿参数规模的通用大模型。这一重磅发布不仅标志着蚂蚁正式跻身“万亿参数开源俱乐部”,更在多项复杂推理任务中刷新纪录,展现出超越当前主流闭源与开源模型的强大能力。Ling-1T一经亮相,便在代码生成、数学解题、逻辑推演和软件开发等高难度基准测试中取得SOTA(State-of-the-Art)表现,甚至力压GPT-5-main与Gemini-2.5-Pro等顶级闭源模型。

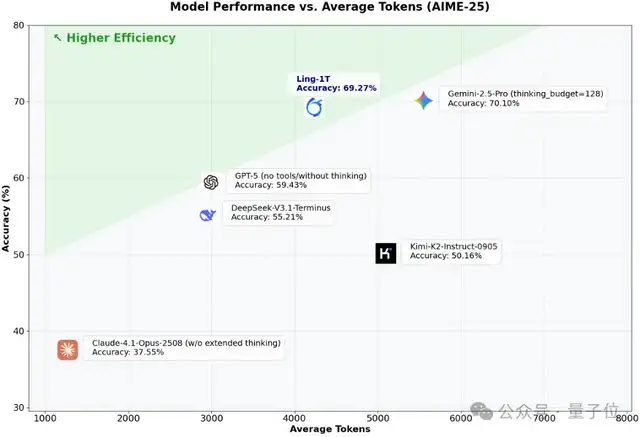

尤为引人注目的是Ling-1T在复杂推理效率与响应速度上的突破性进展。该模型具备近乎即时的思考启动机制,用户输入刚完成,推理进程即刻激活,无论是处理长上下文逻辑链还是生成多轮交互,都能保持流畅、低延迟的输出体验。在AIME 2025数学竞赛榜单上,Ling-1T以显著优势领先其他同类模型,充分验证了其在高阶思维任务中的卓越性能。例如面对经典的“甘蔗过门”空间几何问题,Ling-1T不仅能准确识别为优化类难题,还提出了四种可行方案,并逐一进行物理可行性分析与风险评估,展现出系统化、结构化的深度推理能力。

在数学建模方面,Ling-1T的表现同样令人惊艳。面对概率递归类难题——“外星人分裂问题”,模型迅速构建动态过程模型,通过建立方程并求解极限状态,最终得出精确答案 √2−1,整个推理链条清晰严谨,体现出强大的抽象建模与符号运算能力。而在实际应用场景中,如生成诺贝尔奖专题网站时,Ling-1T自动将信息划分为概览、奖项分类、历史时间轴等多个模块,结构合理、语义连贯,极大提升了信息可读性与用户体验。

不仅如此,Ling-1T在编程与前端开发任务中也表现出色。基于其提出的“语法–功能–美学”三重混合奖励机制,模型生成的代码不仅功能完整、逻辑正确,还能兼顾界面美观与交互体验。在ArtifactsBench前端能力评测中,Ling-1T成为当前开源模型中的第一名,彰显其在真实工程场景下的实用价值。即便是规划旅游路线这类生活化任务,它也能智能整合景点特色、交通方式、餐饮推荐与预算控制,提供个性化、标签化的一站式出行建议。

支撑这一切的背后,是蚂蚁团队在模型架构与训练范式上的深度创新。Ling-1T沿用Ling 2.0架构基础,将总参数扩展至1万亿,每个token激活约500亿参数,支持最长128K上下文窗口。训练策略采用“中训练+后训练”结合的演进式思维链(Evo-CoT)方法,分阶段强化知识积累与逻辑推理能力:第一阶段使用10T高知识密度语料打基础;第二阶段引入10T高推理密度数据提升多步推导能力;中间训练阶段则扩大上下文至32K,并融入思维链示例,为后续推理优化做准备。

为提升训练稳定性与收敛效果,研究团队摒弃传统学习率衰减策略,自主研发WSM(Warmup-Stable-Merge)框架,通过预热、稳定训练与模型融合三步走,在不降低学习率的前提下实现性能跃升。实验表明,模型合并的时间窗口比合并次数更为关键,合理选择融合时机可显著增强泛化能力。此外,在后训练阶段,针对现有强化学习算法GRPO碎片化、GSPO过度平滑的问题,团队首创Linguistics-Unit Policy Optimization(LingPO)方法,以“句子”为基本单位进行策略优化,既保留语义完整性,又提升局部逻辑训练精度,使奖励信号与语言行为精准对齐。

Ling-1T的开源不仅是技术成果的释放,更是中国大模型生态持续爆发的重要信号。今年以来,从DeepSeek搅动格局,到通义千问Qwen系列全面进化,再到如今蚂蚁推出万亿级推理强模,国产开源力量正以前所未有的节奏推动全球AI发展。尤其在国庆假期刚结束之际,蚂蚁迅速接棒Qwen与DeepSeek的开源热潮,接连发布关键技术成果,显示出中国科技企业在大模型赛道上的强劲动能与战略定力。

可以预见,随着更多高质量开源模型的涌现,AI在科研、教育、工程和日常应用中的边界将持续被拓宽。而Ling-1T的出现,不仅为开发者提供了新的高性能工具,也为行业探索“高效思考型AI”提供了全新范式。下一个颠覆性突破,或许依然会来自中国。

Ling-1T, 蚂蚁开源大模型, 万亿参数模型, 复杂推理SOTA, 高效思维链

本文来源: 量子位【阅读原文】

量子位【阅读原文】