(由多段落组成):

近日,阿里通义千问团队重磅发布全新一代原生全模态大模型——Qwen3-Omni-Flash-2025-12-01,引发业界广泛关注。该模型于2025年12月9日正式上线,作为Qwen3-Omni的全面升级版本,在多模态处理能力、响应效率与交互自然度方面实现多项突破,标志着AI智能体在“感知—理解—表达”闭环上的又一次进化。

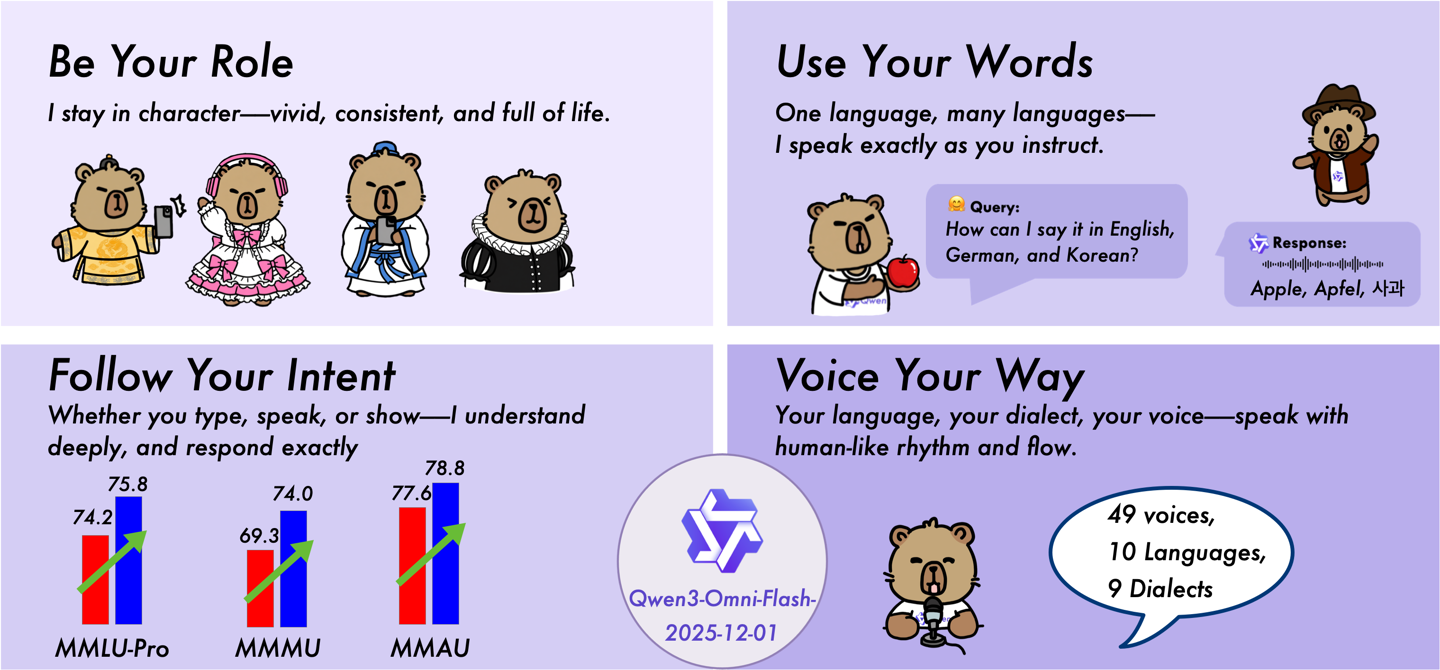

此次推出的Qwen3-Omni-Flash支持文本、图像、音频和视频的无缝融合输入,并具备实时流式输出能力,能够同步生成高质量文本与高度拟人化的语音。相比前代模型,新版本显著优化了对复杂指令的理解力,尤其在音视频指令执行场景中表现出更强的语义解析能力,有效解决了以往语音交互中存在的“降智”问题,让AI真正听懂用户所言,理解背后意图。

值得一提的是,Qwen3-Omni-Flash在对话连贯性与语音自然度方面取得重大进展。系统可依据上下文智能调节语速、停顿节奏与语音韵律,彻底摆脱传统AI语音机械呆板的印象,语音输出流畅度接近真人水平,为语音助手、虚拟主播、智能客服等应用场景带来更沉浸的用户体验。

本次更新的一大亮点是全面开放了System Prompt自定义功能,赋予用户前所未有的控制权。无论是设定“甜妹风”、“御姐范儿”还是“日系声线”,亦或是调整回复风格偏向简洁或详尽,用户均可通过系统提示词精准定义模型行为,打造专属个性化的AI角色,极大拓展了模型在创作、情感陪伴等领域的应用潜力。

语言支持方面,Qwen3-Omni-Flash进一步强化全球化服务能力,支持多达119种语言的文本交互、19种语言的语音识别以及10种语言的语音合成,确保跨语言沟通准确无误,助力企业出海、国际教育及多语种生产等需求。

性能表现上,该模型在多项权威基准测试中刷新纪录:逻辑推理任务ZebraLogic得分提升5.6分,代码生成评测LiveCodeBench-v6提升9.3分,多学科视觉问答MMMU提升4.7分。这些数据不仅体现了其在视觉理解、复杂逻辑推导和编程能力上的领先优势,也验证了其作为全能型AI底座的强大潜力。

随着Qwen3-Omni-Flash的推出,阿里云持续领跑大模型技术创新赛道,推动多模态AI向更智能、更自然、更可控的方向演进,为开发者与终端用户开启下一代人机交互的新篇章。

Qwen3-Omni-Flash, 全模态大模型, 多模态AI, 语音合成, System Prompt

本文来源: IT之家【阅读原文】

IT之家【阅读原文】