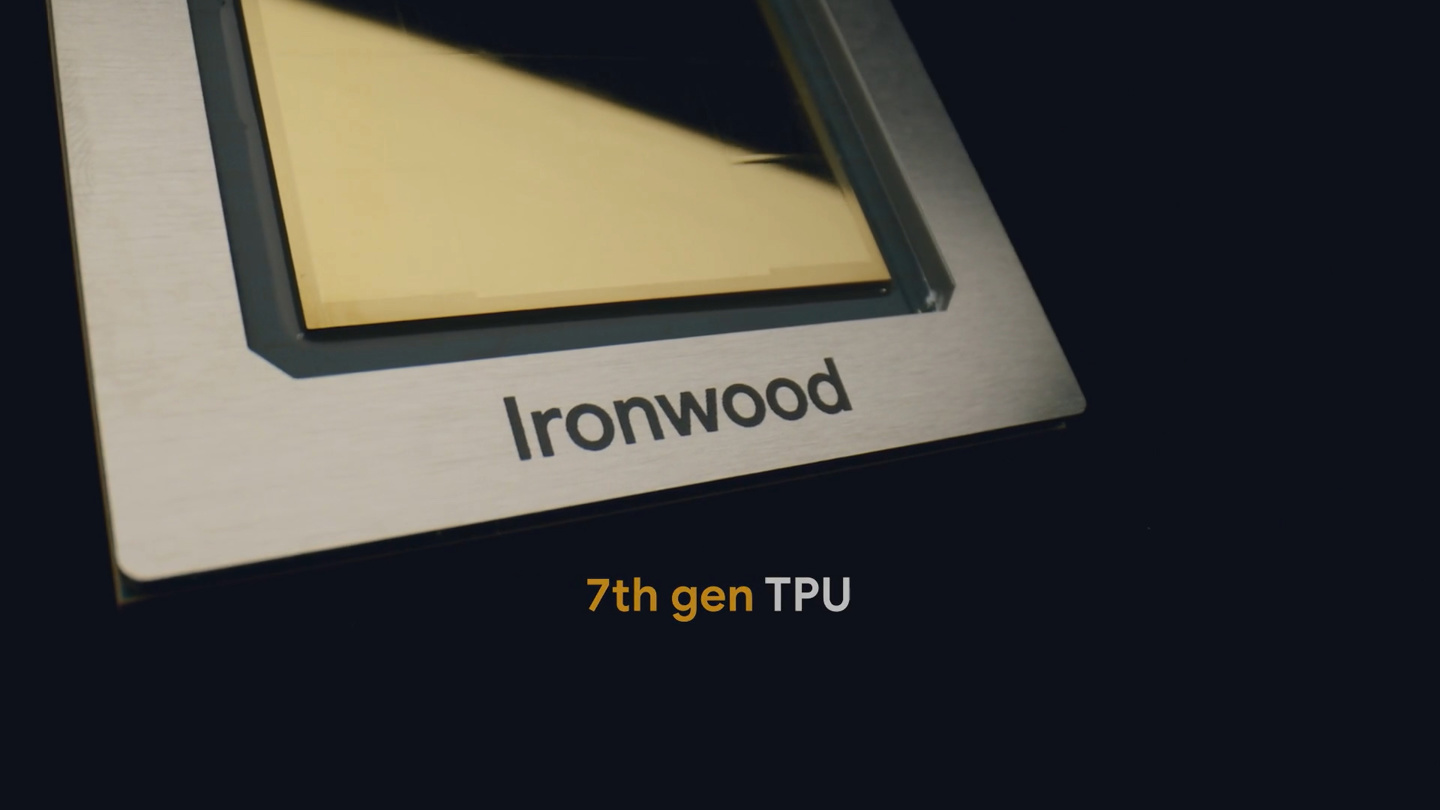

谷歌自研的TPU(张量处理单元)芯片已有多年发展历史,并经历了多次技术迭代。作为专为人工智能计算设计的ASIC芯片,TPU不仅支撑了谷歌内部的AI业务,也通过Google Cloud对外提供云端算力服务,服务于包括OpenAI在内的多个合作伙伴。然而,迄今为止,谷歌TPU芯片的部署范围仍仅限于其自有的数据中心,尚未对外部物理环境进行开放部署。

据外媒The Information最新报道,谷歌正计划打破这一限制。目前,谷歌正在与多家专注于对外租赁英伟达AI GPU的小型云服务商进行洽谈,意图将TPU芯片引入这些第三方数据中心。这意味着谷歌或将首次将TPU芯片部署到其自有设施之外的环境中。

值得注意的是,谷歌已经与其中一家公司Fluidstack达成了初步合作意向。这一动作可能标志着谷歌AI战略的重大转变。通过将TPU芯片部署到外部云服务商的数据中心,谷歌不仅可以扩大其AI算力的覆盖范围,还能有效缓解自建数据中心在容量和地域上的限制。

此外,谷歌此举也被视为对英伟达GPU在AI芯片市场主导地位的一次有力挑战。随着AI训练和推理需求的不断增长,越来越多的企业开始寻求多样化、高性能的算力解决方案。谷歌希望借助其TPU芯片在能效和AI模型训练上的优势,争夺更多市场份额,进一步巩固其在全球AI芯片领域的重要地位。

谷歌TPU芯片, AI算力部署, 英伟达GPU, 云端AI芯片, 数据中心托管

本文来源: IT之家【阅读原文】

IT之家【阅读原文】 © 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...