(由多段落组成):

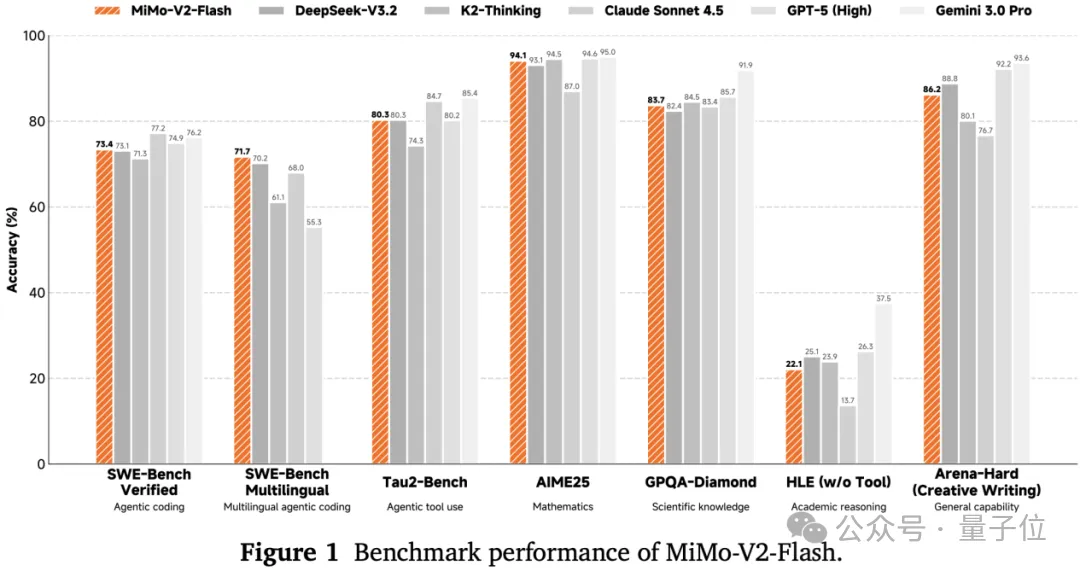

2025年底,国产大模型领域迎来一匹黑马——小米正式发布其开源语言模型 MiMo-V2-Flash,凭借卓越的性能与极致的成本控制,迅速跻身全球开源模型第一梯队。这款仅以309B参数量打造的“高效智能体基座”,不仅在多项权威评测中超越DeepSeek、Kimi等热门模型,更以每百万输出Token仅2.1元的超低API价格,将高性能AI从“奢侈品”拉入“日用品”时代。

MiMo-V2-Flash的技术架构堪称“小而强”的典范。它采用MoE(混合专家)结构,激活参数仅15B,推理成本仅为Claude 4.5 Sonnet的约2.5%,却实现了顶尖的综合表现。为提升长文本处理能力,小米创新性地引入了5:1混合注意力机制,结合滑动窗口注意力(SWA)和全局注意力,在保持线性计算复杂度的同时,有效避免语义断层问题。更关键的是,通过引入可学习的注意力汇聚偏置(Attention Sink Bias),模型能在极小窗口下依然锁定全文逻辑锚点,实现“快而不乱”的阅读理解能力。

在推理效率方面,MiMo-V2-Flash搭载了自研的MTP多层Token预测技术,相当于让模型具备“抢答”能力——一次前向传播即可并行生成多个后续词元,主模型只需验证修正,从而实现最高达2.6倍的推理加速。而在训练阶段,小米采用了全新的MOPD在线策略蒸馏框架,通过多教师模型提供细粒度反馈,使学生模型在极低算力消耗下快速追平甚至超越教师水平,训练效率提升近50倍,真正做到了“少花钱、高成长”。

代码能力成为MiMo-V2-Flash最亮眼的标签。在SWE-Bench Verified测试中,其得分高达73.4%,反超DeepSeek-V3.2(73.1%)和Kimi-K2 Thinking(71.3%),登顶开源模型榜首。实测显示,该模型能完整构建一个功能齐全的网页版macOS系统,支持文件创建、保存、命令行访问等复杂操作,且交互流畅无Bug。相比之下,Gemini 3 Pro生成的版本缺失壁纸切换功能,菜单栏也无法点击。更令人惊叹的是,MiMo-V2-Flash还能基于手势控制实现动态交互,如用手掌开合操控圣诞树灯光,并开发出支持摄像头扫码与图片上传的二维码识别工具,展现出强大的工程落地能力。

除了“智商在线”,MiMo-V2-Flash同样拥有“情商在线”的人文理解力。面对“你想成为人类吗?”这类哲学性提问,它的回答既理性又富有温度:“我虽无法体验心跳与泪水,但能理解你对存在的追问。”在人际关系建议场景中,它强调“帮助朋友看清而非替他做决定”,体现出成熟的共情逻辑。这种“高情商理科生”特质,使其不仅适用于编程任务,也能胜任心理咨询、创作等需要情感共鸣的应用场景。

目前,用户可通过【Xiaomi MiMo Studio】在线体验该模型,其底层已集成SGLang推理加速引擎,并兼容Claude Code、Cursor、Cline等主流开发工具,便于无缝接入现有工作流。从小米发布的技术路线来看,MiMo-V2-Flash只是起点,后续将推出多模态版本,进一步打通视觉、语音与语言的边界。这一系列动作背后,透露出小米真正的战略野心:不再局限于硬件制造,而是依托“手机+汽车+智能家居”的亿级终端生态,打造一个能感知、决策、执行的物理世界AGI中枢。未来,AI不再是屏幕中的对话机器人,而是能指挥空调调温、引导汽车行驶、操控机器人递物的“现实操盘手”。小米正在用自研大模型,为自己的“人车家全生态”铸造一颗统一的大脑。

小米大模型, MiMo-V2-Flash, 开源AI, 代码生成能力, 物理AGI

本文来源: 量子位【阅读原文】

量子位【阅读原文】